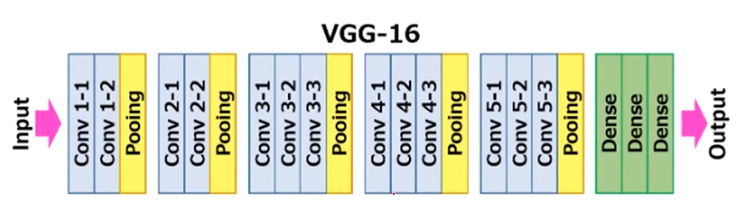

💡Network Learing Rate는 Gradient의 보폭을 말한다. Deep Learning Network이 확률적 경사 하강법(SGD) 최적화 알고리즘을 사용하여 훈련 하는 데, 사용되는 파라미터이다. Learing Rate는 성능에 꽤 큰 영향을 주는 파라미터이며, 학습되는 모델의 weight의 최적값을 어떻게 찾아 나갈 지 보폭을 정한다. (hyper param) ▶ Hyper Parameter는 user가 직접 셋팅 할 수 있는 값이며, knn or lr rate 등.. 👉 특징 Network Depth와 성능 영향에 집중을 위해 등장 하였으며, Kernel Size가 크면 Image Size 축소가 급격하게 이뤄져서 더 깊은 층을 만들기 어려우며, Parameter 수와 많은 연산량도 필..